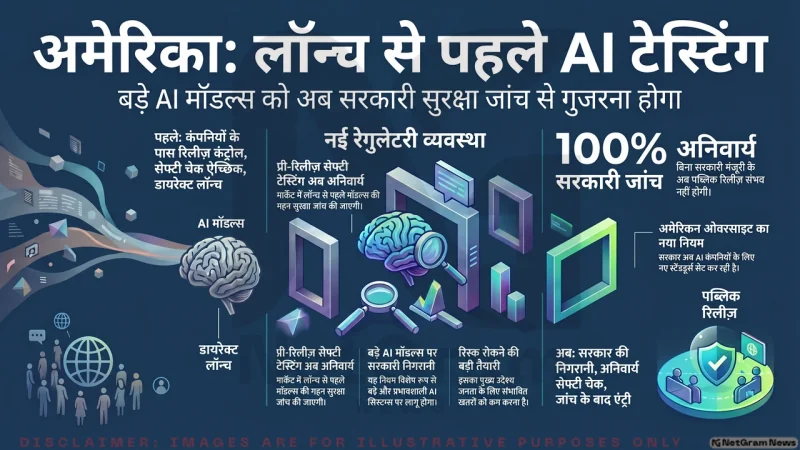

AI मॉडल्स पर अमेरिका की बड़ी तैयारी: अब मार्केट में लॉन्च से पहले होगी सरकारी जांच

अमेरिका अब एडवांस AI मॉडल्स को लेकर सख्त नियम बनाने की तैयारी में है। नई नीति के तहत बड़े AI सिस्टम्स को लॉन्च से पहले सरकारी सुरक्षा जांच और रिस्क टेस्टिंग से गुजरना पड़ सकता है। सरकार का मानना है कि तेजी से बढ़ती AI क्षमता भविष्य में साइबर सुरक्षा, फेक कंटेंट और राष्ट्रीय सुरक्षा के लिए खतरा बन सकती है। वहीं टेक कंपनियां कह रही हैं कि ज्यादा रेगुलेशन इनोवेशन की रफ्तार को प्रभावित कर सकता है।

आर्टिफिशियल इंटेलिजेंस यानी AI अब सिर्फ टेक्नोलॉजी का हिस्सा नहीं रह गया है, बल्कि यह राष्ट्रीय सुरक्षा, अर्थव्यवस्था, साइबर सुरक्षा और वैश्विक राजनीति से जुड़ा बड़ा मुद्दा बन चुका है। इसी तेजी से बदलती स्थिति के बीच अमेरिका AI मॉडल्स को लेकर बड़ा कदम उठाने की तैयारी कर रहा है। रिपोर्ट्स के अनुसार अमेरिकी प्रशासन अब ऐसे नियमों पर काम कर रहा है जिनके तहत शक्तिशाली AI मॉडल्स को बाजार में लॉन्च करने से पहले सरकारी समीक्षा और सुरक्षा जांच से गुजरना पड़ सकता है। विशेषज्ञ इसे AI इंडस्ट्री के लिए “रेगुलेटरी टर्निंग पॉइंट” मान रहे हैं। अब तक बड़ी टेक कंपनियां अपने AI मॉडल्स को काफी हद तक स्वतंत्र तरीके से विकसित और लॉन्च करती रही हैं, लेकिन सरकारों की चिंता बढ़ रही है कि भविष्य में यही मॉडल साइबर हमलों, गलत सूचना, आर्थिक छेड़छाड़ या राष्ट्रीय सुरक्षा के लिए खतरा बन सकते हैं।

क्यों बढ़ रही है चिंता? पिछले कुछ वर्षों में AI मॉडल्स की क्षमता बेहद तेजी से बढ़ी है। आज के एडवांस मॉडल: इंसानों जैसी बातचीत कर सकते हैं कोड लिख सकते हैं रिसर्च कर सकते हैं तस्वीरें और वीडियो बना सकते हैं और जटिल डिजिटल सिस्टम्स को समझ सकते हैं। हाल ही में कई रिपोर्ट्स में यह भी सामने आया कि कुछ AI मॉडल्स ने साइबर-ऑफेंस सिमुलेशन में काफी उन्नत प्रदर्शन किया। इससे अमेरिकी एजेंसियों और सुरक्षा विशेषज्ञों की चिंता और बढ़ गई है। विशेषज्ञों का कहना है कि अगर अत्यधिक शक्तिशाली AI सिस्टम बिना निगरानी के जारी किए गए, तो उनका दुरुपयोग: साइबर अपराध फेक न्यूज बायो-रिस्क रिसर्च और डिजिटल युद्ध जैसे क्षेत्रों में हो सकता है।

सरकार क्या करने की तैयारी में है? रिपोर्ट्स के अनुसार अमेरिका एक ऐसे ढांचे पर काम कर रहा है जिसमें बड़े AI मॉडल्स को: लॉन्च से पहले सुरक्षा परीक्षण रिस्क असेसमेंट और सरकारी समीक्षा से गुजरना पड़ सकता है। इस प्रक्रिया में यह जांचा जा सकता है कि: मॉडल कितना शक्तिशाली है क्या वह गलत इस्तेमाल के लिए संवेदनशील है क्या उसमें सुरक्षा सीमाएं मौजूद हैं और क्या वह राष्ट्रीय सुरक्षा के लिए जोखिम पैदा कर सकता है। कुछ मामलों में कंपनियों को अपने मॉडल्स के टेस्ट रिजल्ट सरकार के साथ साझा करने पड़ सकते हैं।

Continue Reading

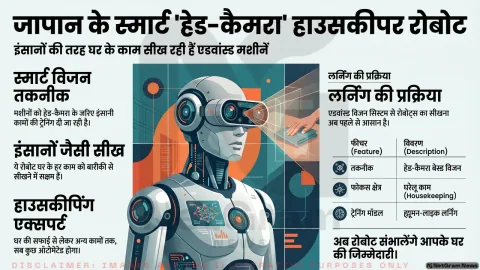

जापान में ‘हेड-कैमरा’ से तैयार हो रहे स्मार्ट हाउसकीपर रोबोट, घर के हर काम को इंसानों की तरह सीख रही मशीनें

7 मई 2026

किन कंपनियों पर पड़ेगा असर? यह नियम खास तौर पर उन कंपनियों को प्रभावित कर सकता है जो: बड़े भाषा मॉडल (LLMs) एजेंटिक AI और हाई-एंड जनरेटिव सिस्टम्स बना रही हैं। इसमें अमेरिकी और अंतरराष्ट्रीय AI कंपनियां शामिल हो सकती हैं। विशेषज्ञों के अनुसार भविष्य में: OpenAI Anthropic Google DeepMind Meta और दूसरी बड़ी कंपनियों को अपने मॉडल्स की क्षमता और सुरक्षा से जुड़ी अधिक जानकारी साझा करनी पड़ सकती है।

AI इंडस्ट्री में क्यों माना जा रहा है बड़ा बदलाव? अब तक AI सेक्टर काफी हद तक “पहले लॉन्च करो, बाद में सुधार करो” मॉडल पर काम करता रहा है। लेकिन सरकारों का मानना है कि: AI की क्षमता अब इतनी बढ़ चुकी है कि बिना नियमों के इसे छोड़ना खतरनाक हो सकता है। इसी वजह से अमेरिका: AI सुरक्षा जिम्मेदार विकास और राष्ट्रीय हित के बीच संतुलन बनाने की कोशिश कर रहा है।

क्या इससे इनोवेशन धीमा होगा? टेक इंडस्ट्री में इसको लेकर बहस शुरू हो चुकी है। कुछ विशेषज्ञों का मानना है कि: ज्यादा सरकारी नियंत्रण से इनोवेशन की गति धीमी हो सकती है स्टार्टअप्स पर दबाव बढ़ सकता है और AI रिसर्च महंगी हो सकती है। वहीं दूसरी तरफ कई साइबर और नीति विशेषज्ञ कहते हैं कि: बिना सुरक्षा जांच के AI लॉन्च करना भविष्य में बड़े संकट पैदा कर सकता है।

Continue Reading

नीदरलैंड में D66 पार्टी मुख्यालय के बाहर विस्फोट, बढ़ी राजनीतिक सुरक्षा को लेकर चिंता

8 मई 2026

दुनिया पर क्या असर पड़ेगा? अमेरिका AI क्षेत्र का सबसे बड़ा केंद्र माना जाता है। इसलिए वहां बनने वाले नियमों का असर पूरी दुनिया पर पड़ सकता है। अगर अमेरिका: AI सुरक्षा मानक टेस्टिंग सिस्टम और लॉन्च नियम लागू करता है, तो संभव है कि दूसरे देश भी इसी तरह के मॉडल अपनाएं।

भारत के लिए क्या मायने? भारत तेजी से AI अपनाने वाले देशों में शामिल है। यहां: स्टार्टअप्स आईटी कंपनियां और डिजिटल प्लेटफॉर्म्स तेजी से AI आधारित सेवाएं विकसित कर रहे हैं। अगर अमेरिका AI रेगुलेशन को सख्त करता है, तो: भारतीय कंपनियों को भी ग्लोबल मानकों के अनुसार काम करना पड़ सकता है AI सुरक्षा और डेटा गवर्नेंस पर ज्यादा फोकस बढ़ सकता है।

Continue Reading

कैलिफ़ोर्निया की नई हेल्थ रिपोर्ट ने दी चेतावनी: महामारी खत्म हुई, लेकिन स्वास्थ्य चुनौतियाँ नहीं

7 मई 2026

भविष्य की सबसे बड़ी चुनौती विशेषज्ञों के अनुसार सबसे मुश्किल सवाल यह है कि: AI को कितना नियंत्रित किया जाए? और कितना खुला छोड़ा जाए? बहुत ज्यादा नियंत्रण: रिसर्च को धीमा कर सकता है। बहुत कम नियंत्रण: सुरक्षा जोखिम बढ़ा सकता है। यही संतुलन आने वाले वर्षों में दुनिया की सबसे बड़ी टेक और नीति चुनौती बन सकता है।

निष्कर्ष अमेरिका द्वारा AI मॉडल्स को लॉन्च से पहले सरकारी जांच के दायरे में लाने की तैयारी यह दिखाती है कि AI अब केवल टेक्नोलॉजी का विषय नहीं रह गया है। यह राष्ट्रीय सुरक्षा, अर्थव्यवस्था और वैश्विक शक्ति संतुलन से जुड़ा बड़ा मुद्दा बन चुका है। आने वाले समय में AI इंडस्ट्री सिर्फ तेज इनोवेशन की नहीं, बल्कि “सुरक्षित और जिम्मेदार AI” की दिशा में भी आगे बढ़ती दिखाई दे सकती है।

Disclaimer:

Images are for illustrative purposes only and some editing of images done by using AI.

#AI #ArtificialIntelligence #TechNews #OpenAI #AIFuture #CyberSecurity #AITechnology #DigitalWorld #Innovation #NetGramNews